- Blog

- Offizielle Veröffentlichung von DeepSeek-V4: Millionen-Token-Kontext, hybride Aufmerksamkeitsarchitektur und eine neue SOTA für offene Modelle

Offizielle Veröffentlichung von DeepSeek-V4: Millionen-Token-Kontext, hybride Aufmerksamkeitsarchitektur und eine neue SOTA für offene Modelle

Heute markiert die offizielle Veröffentlichung von DeepSeek-V4. Mit der offiziellen Veröffentlichung von DeepSeek-V4 hat das Team den Millionen-Token-Kontext gemeistert. Durch die Einführung einer hybriden Aufmerksamkeitsarchitektur etabliert dieses Update eine neue SOTA für offene Modelle.

Die offizielle Veröffentlichung von DeepSeek-V4 bricht die Effizienzbarriere. Hier zeigen wir, wie die hybride Aufmerksamkeitsarchitektur und der Millionen-Token-Kontext die neue SOTA für offene Modelle definieren.

1. Die Modellmatrix: Gebaut für den Millionen-Token-Kontext

Die offizielle Veröffentlichung von DeepSeek-V4 enthält zwei MoE-Modelle, die beide einen Millionen-Token-Kontext unterstützen:

- DeepSeek-V4-Pro: Bewältigt problemlos einen Millionen-Token-Kontext.

- DeepSeek-V4-Flash: Macht den Millionen-Token-Kontext sehr zugänglich.

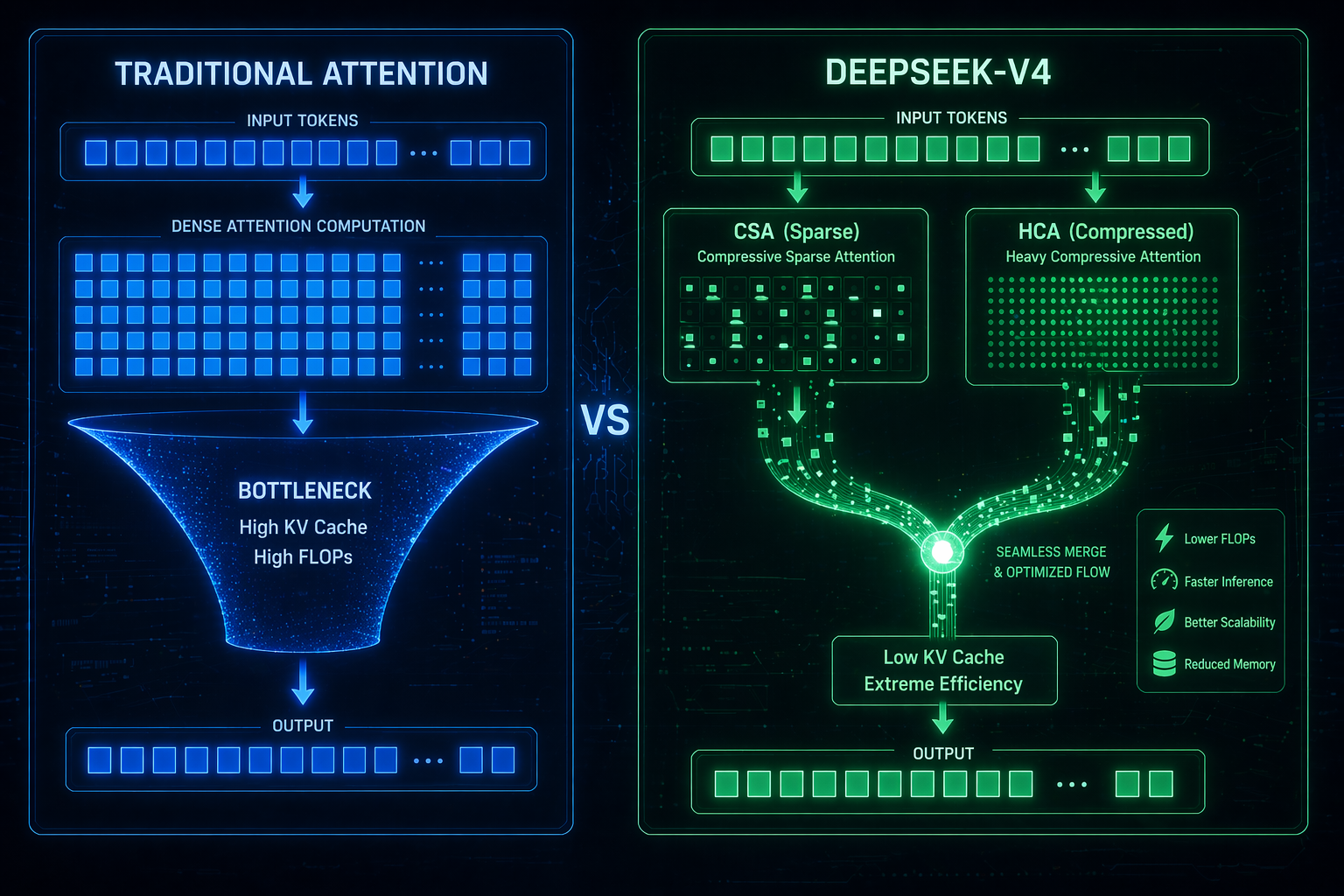

2. Durchbruch: Die hybride Aufmerksamkeitsarchitektur

Für extreme Effizienz bei einem Millionen-Token-Kontext führt die offizielle Veröffentlichung von DeepSeek-V4 ihre hybride Aufmerksamkeitsarchitektur ein:

- Hybride Aufmerksamkeitsarchitektur: Diese hybride Aufmerksamkeitsarchitektur kombiniert CSA und HCA.

3. Effizienz durch die hybride Aufmerksamkeitsarchitektur

Ein Millionen-Token-Kontext erfordert viel Rechenleistung, aber die offizielle Veröffentlichung von DeepSeek-V4 zeigt eine unglaubliche Optimierung:

- Angetrieben von der hybriden Aufmerksamkeitsarchitektur benötigt V4-Pro nur 27% der FLOPs.

- Unter demselben Millionen-Token-Kontext beträgt der KV-Cache nur 10%.

4. Benchmarks: Eine neue SOTA für offene Modelle

Die offizielle Veröffentlichung von DeepSeek-V4 sichert diese neue SOTA für offene Modelle.

- DeepSeek-V4-Pro-Max definiert die neue SOTA für offene Modelle neu.

- Beim Programmieren belegt diese neue SOTA für offene Modelle Platz 23 auf Codeforces.

- Bei Putnam-2025 erreichte die offizielle Veröffentlichung von DeepSeek-V4 120/120.

5. Upgrades für Agentic AI

Über den Millionen-Token-Kontext hinaus festigt die offizielle Veröffentlichung von DeepSeek-V4 ihre Position als neue SOTA für offene Modelle.

Fazit

Die offizielle Veröffentlichung von DeepSeek-V4 ist mehr als ein Upgrade. Durch eine hybride Aufmerksamkeitsarchitektur wurde der Millionen-Token-Kontext zur Realität. Wir erleben eine neue SOTA für offene Modelle.