- Blog

- Lanzamiento oficial de DeepSeek-V4: Contexto de un millón de tokens, arquitectura de atención híbrida y un nuevo SOTA para modelos abiertos

Lanzamiento oficial de DeepSeek-V4: Contexto de un millón de tokens, arquitectura de atención híbrida y un nuevo SOTA para modelos abiertos

Hoy marca el esperado lanzamiento oficial de DeepSeek-V4. Con el lanzamiento oficial de DeepSeek-V4, el equipo ha dado un salto monumental, dominando el contexto de un millón de tokens. Al introducir una revolucionaria arquitectura de atención híbrida, esta actualización establece un definitivo nuevo SOTA para modelos abiertos.

A través de una profunda reconstrucción, el lanzamiento oficial de DeepSeek-V4 rompe la barrera de la eficiencia. Aquí destacamos cómo su arquitectura de atención híbrida y el contexto de un millón de tokens redefinen el nuevo SOTA para modelos abiertos.

1. La matriz principal: Construida para un contexto de un millón de tokens

La vista previa del lanzamiento oficial de DeepSeek-V4 incluye dos modelos MoE, ambos soportando un contexto de un millón de tokens:

- DeepSeek-V4-Pro: Maneja fácilmente un contexto de un millón de tokens.

- DeepSeek-V4-Flash: Hace que el contexto de un millón de tokens sea muy accesible.

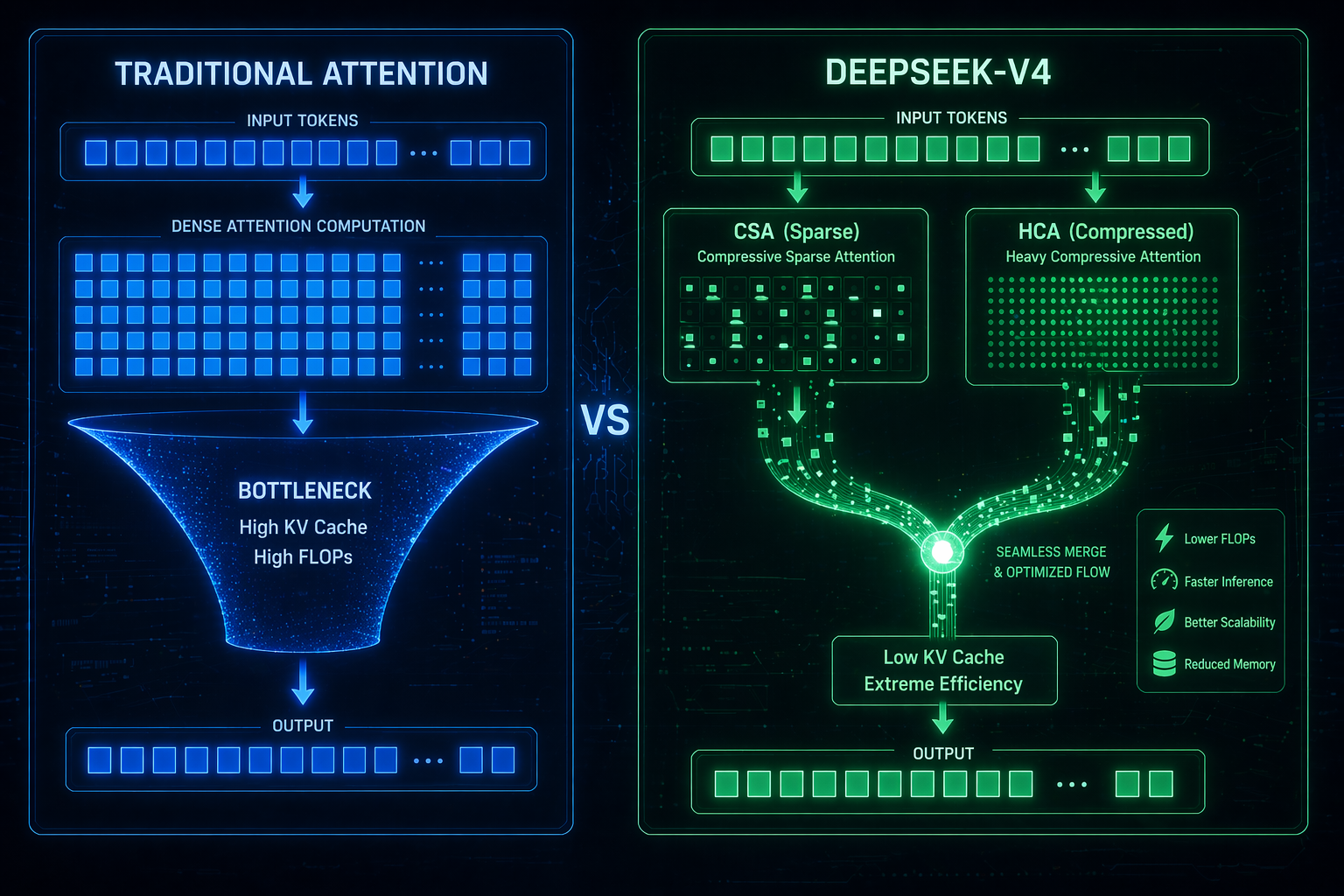

2. Gran avance: La arquitectura de atención híbrida

Para lograr extrema eficiencia bajo un contexto de un millón de tokens, el lanzamiento oficial de DeepSeek-V4 presenta innovaciones lideradas por su arquitectura de atención híbrida:

- Arquitectura de atención híbrida: Esta arquitectura de atención híbrida combina CSA y HCA.

- Conexiones mHC: Mejora las conexiones junto con la arquitectura de atención híbrida.

3. Eficiencia impulsada por la arquitectura de atención híbrida

Procesar un contexto de un millón de tokens requiere poder, pero el lanzamiento oficial de DeepSeek-V4 demuestra una optimización increíble:

- Impulsado por la arquitectura de atención híbrida, V4-Pro requiere solo el 27% de los FLOPs de V3.2.

- Bajo el mismo contexto de un millón de tokens, su requisito de KV Cache es solo el 10%.

4. Benchmarks: Un nuevo SOTA para modelos abiertos

El lanzamiento oficial de DeepSeek-V4 fue pre-entrenado para asegurar este nuevo SOTA para modelos abiertos.

- DeepSeek-V4-Pro-Max redefine el nuevo SOTA para modelos abiertos.

- En programación competitiva, este nuevo SOTA para modelos abiertos ocupa el puesto 23.

- En Putnam-2025, el lanzamiento oficial de DeepSeek-V4 logró 120/120.

5. Actualizaciones para IA Agéntica

Más allá del contexto de un millón de tokens, el lanzamiento oficial de DeepSeek-V4 actualiza sus herramientas para solidificarse como el nuevo SOTA para modelos abiertos.

Conclusión

El lanzamiento oficial de DeepSeek-V4 es más que una actualización. Al implementar una arquitectura de atención híbrida, ha convertido el contexto de un millón de tokens en una realidad. Estamos presenciando un nuevo SOTA para modelos abiertos.