- 블로그

- DeepSeek-V4 공식 출시: 백만 토큰 컨텍스트, 하이브리드 어텐션 아키텍처, 오픈 모델의 새로운 SOTA

DeepSeek-V4 공식 출시: 백만 토큰 컨텍스트, 하이브리드 어텐션 아키텍처, 오픈 모델의 새로운 SOTA

Fanch AIon 22 days ago

오늘은 대망의 DeepSeek-V4 공식 출시 날입니다. DeepSeek-V4 공식 출시와 함께 팀은 백만 토큰 컨텍스트를 마스터했습니다. 혁신적인 하이브리드 어텐션 아키텍처를 도입함으로써 이 업데이트는 오픈 모델의 새로운 SOTA를 확립합니다.

DeepSeek-V4 공식 출시는 초장기 처리의 효율성 장벽을 허물었습니다. 하이브리드 어텐션 아키텍처와 백만 토큰 컨텍스트가 어떻게 오픈 모델의 새로운 SOTA를 재정의하는지 살펴보겠습니다.

1. 코어 모델: 백만 토큰 컨텍스트를 위한 설계

DeepSeek-V4 공식 출시에는 백만 토큰 컨텍스트를 기본적으로 지원하는 두 개의 MoE 모델이 포함됩니다.

- DeepSeek-V4-Pro: 백만 토큰 컨텍스트를 쉽게 처리합니다.

- DeepSeek-V4-Flash: 백만 토큰 컨텍스트에 대한 접근성을 높입니다.

2. 돌파구: 하이브리드 어텐션 아키텍처

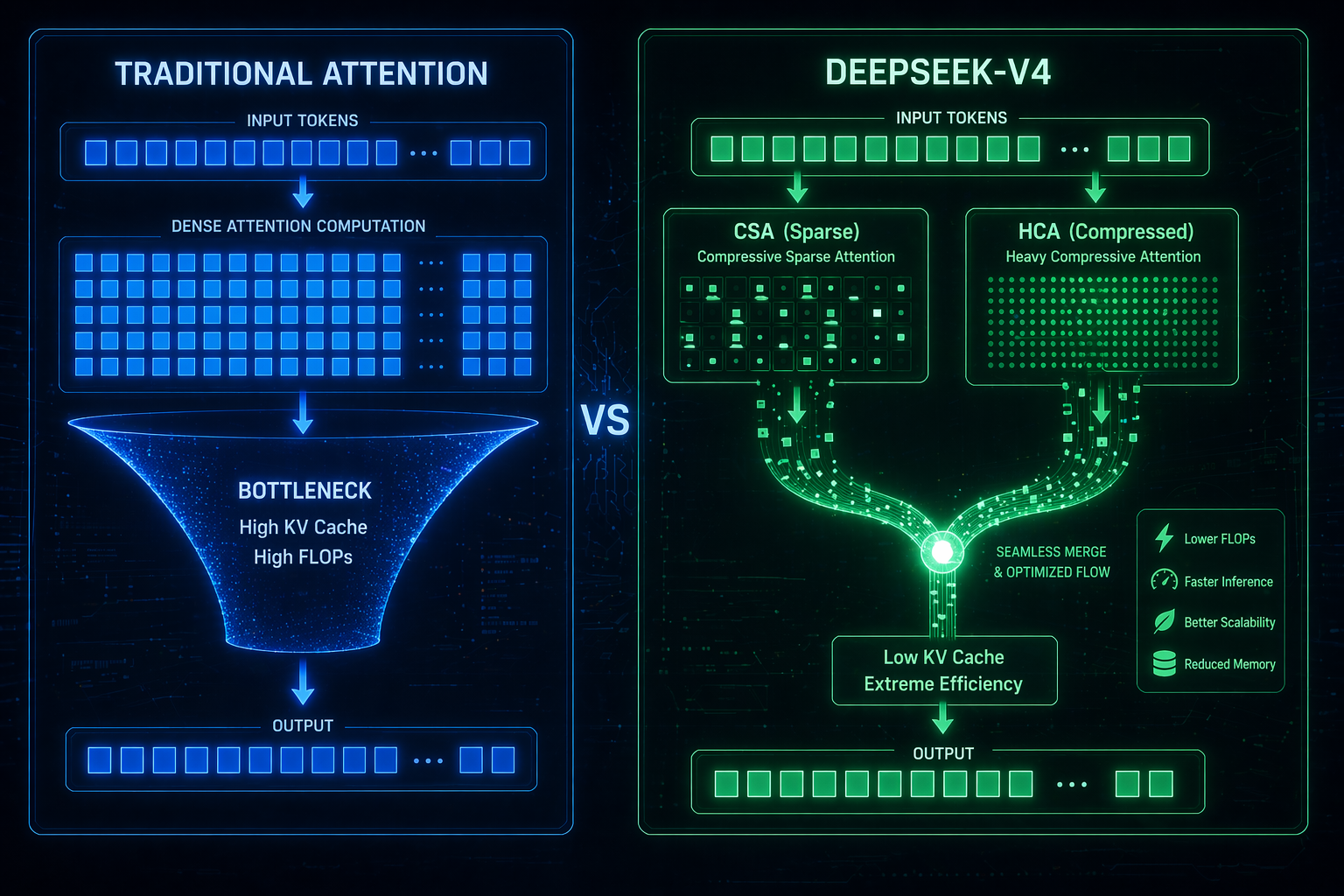

백만 토큰 컨텍스트에서 극한의 효율성을 위해 DeepSeek-V4 공식 출시는 하이브리드 어텐션 아키텍처를 도입했습니다.

- 하이브리드 어텐션 아키텍처: 이 하이브리드 어텐션 아키텍처는 CSA와 HCA를 결합합니다.

3. 하이브리드 어텐션 아키텍처를 통한 효율성

백만 토큰 컨텍스트를 처리하려면 엄청난 컴퓨팅이 필요하지만 DeepSeek-V4 공식 출시는 놀라운 최적화를 보여줍니다.

- 하이브리드 어텐션 아키텍처로 구동되는 V4-Pro는 V3.2 FLOPs의 27%만 필요로 합니다.

- 동일한 백만 토큰 컨텍스트에서 KV 캐시는 10%에 불과합니다.

4. 벤치마크: 오픈 모델의 새로운 SOTA

DeepSeek-V4 공식 출시는 이 오픈 모델의 새로운 SOTA를 확보하기 위해 사전 훈련되었습니다.

- DeepSeek-V4-Pro-Max는 오픈 모델의 새로운 SOTA를 재정의합니다.

- 경쟁 프로그래밍에서 이 오픈 모델의 새로운 SOTA는 Codeforces에서 23위를 차지했습니다.

- Putnam-2025에서 DeepSeek-V4 공식 출시는 120/120을 달성했습니다.

5. 에이전트 AI를 위한 업그레이드

백만 토큰 컨텍스트를 넘어 DeepSeek-V4 공식 출시는 오픈 모델의 새로운 SOTA로서의 입지를 공고히 합니다.

결론

DeepSeek-V4 공식 출시는 획기적인 하이브리드 어텐션 아키텍처를 통해 백만 토큰 컨텍스트를 현실로 만들었습니다. 우리는 오픈 모델의 새로운 SOTA를 목격하고 있습니다.