- Blog

- Lançamento oficial do DeepSeek-V4: Contexto de um milhão de tokens, arquitetura de atenção híbrida e um novo SOTA para modelos abertos

Lançamento oficial do DeepSeek-V4: Contexto de um milhão de tokens, arquitetura de atenção híbrida e um novo SOTA para modelos abertos

Hoje marca o tão esperado lançamento oficial do DeepSeek-V4. Com o lançamento oficial do DeepSeek-V4, a equipe dominou o contexto de um milhão de tokens. Ao introduzir uma arquitetura de atenção híbrida, esta atualização estabelece um novo SOTA para modelos abertos.

O lançamento oficial do DeepSeek-V4 quebra a barreira da eficiência. Veja como sua arquitetura de atenção híbrida e o contexto de um milhão de tokens redefinem o novo SOTA para modelos abertos.

1. A Matriz de Modelos: Construída para um contexto de um milhão de tokens

O lançamento oficial do DeepSeek-V4 inclui dois modelos MoE, ambos suportando um contexto de um milhão de tokens:

- DeepSeek-V4-Pro: Lida facilmente com um contexto de um milhão de tokens.

- DeepSeek-V4-Flash: Torna o contexto de um milhão de tokens muito acessível.

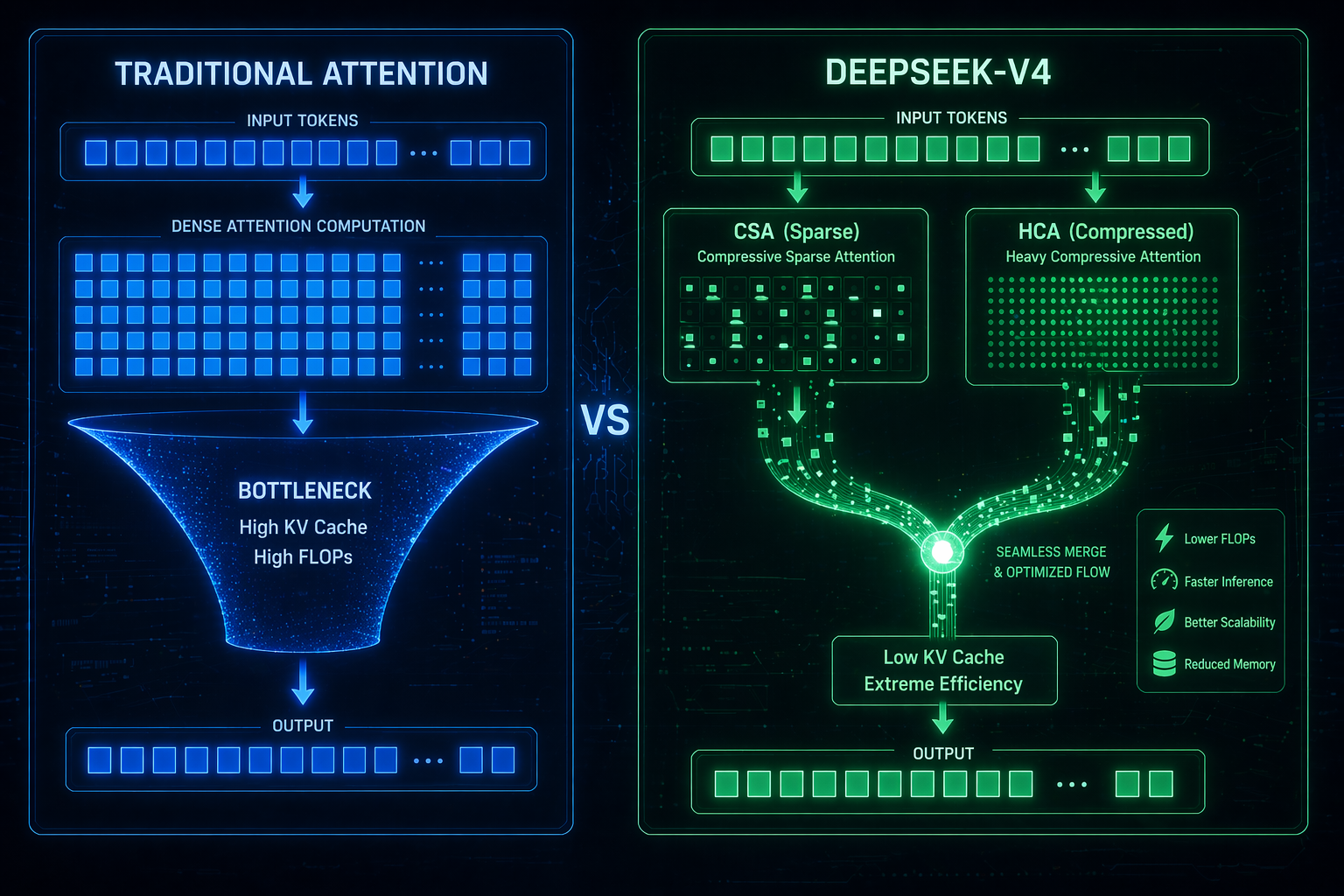

2. Avanço: A arquitetura de atenção híbrida

Para extrema eficiência sob um contexto de um milhão de tokens, o lançamento oficial do DeepSeek-V4 apresenta sua arquitetura de atenção híbrida:

- Arquitetura de atenção híbrida: Esta arquitetura de atenção híbrida combina CSA e HCA.

3. Eficiência impulsionada pela arquitetura de atenção híbrida

Processar um contexto de um milhão de tokens requer poder, mas o lançamento oficial do DeepSeek-V4 demonstra otimização incrível:

- Impulsionado pela arquitetura de atenção híbrida, o V4-Pro requer apenas 27% dos FLOPs.

- Sob o mesmo contexto de um milhão de tokens, o KV Cache é de apenas 10%.

4. Benchmarks: Um novo SOTA para modelos abertos

O lançamento oficial do DeepSeek-V4 garante este novo SOTA para modelos abertos.

- O DeepSeek-V4-Pro-Max redefine o novo SOTA para modelos abertos.

- Em programação, este novo SOTA para modelos abertos ocupa o 23º lugar no Codeforces.

- No Putnam-2025, o lançamento oficial do DeepSeek-V4 atingiu 120/120.

5. Atualizações para IA Agêntica

Além do contexto de um milhão de tokens, o lançamento oficial do DeepSeek-V4 solidifica sua posição como o novo SOTA para modelos abertos.

Conclusão

O lançamento oficial do DeepSeek-V4 transformou o contexto de um milhão de tokens em realidade por meio de uma arquitetura de atenção híbrida. Estamos testemunhando um novo SOTA para modelos abertos.